شهدت السنوات الأخيرة قفزات هائلة في مجال الذكاء الاصطناعي، لدرجة أن الحديث عن نماذج ذكية فائقة لم يعد ضربًا من الخيال العلمي بل أصبح واقعًا ملموسًا تتسارع وتيرته يومًا بعد يوم. ومع هذا التقدم المذهل، تتصاعد أصوات خبراء بارزين في هذا المجال مطالبين بوقف مؤقت لتطوير النماذج الجديدة الأكثر قوة. فما هي الحقيقة وراء هذه المطالبات؟ وما الذي يجعل عام 2026 تاريخًا محوريًا في هذه المخاوف المتزايدة؟ هذا المقال يستعرض الأبعاد المختلفة لهذا النقاش الساخن، ويسلط الضوء على المخاوف المشروعة التي يطرحها رواد الذكاء الاصطناعي، والتحديات التي تواجه البشرية في ظل هذه الثورة التكنولوجية التي لا تتوقف.

التطور السريع والمخاطر غير المتوقعة

لا شك أن سرعة تطور نماذج الذكاء الاصطناعي فاقت معظم التوقعات، حيث نرى إصدارات جديدة تتجاوز قدرات سابقتها بسرعة قياسية. هذا النمو المتسارع، بينما يفتح آفاقًا واعدة، يثير أيضًا قلقًا عميقًا لدى مجتمع الخبراء. فالتطور الذي يستغرق سنوات في مجالات أخرى، يتم إنجازه في أشهر معدودة في عالم الذكاء الاصطناعي.

غياب الفهم الكامل لآلية عمل النماذج المعقدة

تكمن إحدى أبرز المخاوف في ما يُعرف بـ “مشكلة الصندوق الأسود”. فمع زيادة تعقيد النماذج، يصبح فهم كيفية اتخاذها لقراراتها أو كيفية وصولها إلى استنتاجاتها أمرًا بالغ الصعوبة. هذا النقص في الشفافية يثير تساؤلات جدية حول إمكانية التحكم بهذه الأنظمة أو التنبؤ بسلوكياتها في سيناريوهات معقدة وغير متوقعة.

- صعوبة تتبع منطق اتخاذ القرار

- احتمالية ظهور سلوكيات غير مبرمجة

- تحديات في التصحيح والتدخل البشري

الاستخدامات غير المقصودة وسوء الاستغلال المحتمل

مع كل نموذج جديد وأكثر قوة، تتزايد احتمالية استخدامه في أغراض ضارة أو غير أخلاقية. بدءًا من إنتاج معلومات مضللة على نطاق واسع (Deepfakes) وصولًا إلى تطوير أسلحة ذاتية التشغيل بالكامل، فإن المخاطر الأمنية والأخلاقية تتضخم بشكل كبير. يدعو الخبراء إلى ضرورة وضع ضمانات قوية وإجراء تقييمات شاملة للمخاطر قبل إطلاق أي تقنية جديدة قد تكون لها تداعيات كارثية على المجتمع البشري.

مخاوف أخلاقية واجتماعية عميقة

تتجاوز المخاوف التقنية المحضة لتشمل أبعادًا أخلاقية واجتماعية أوسع. فالذكاء الاصطناعي لا يمثل مجرد أداة بل هو قوة تشكيلية للمجتمع الإنساني بأسره، ولهذا يجب التعامل معه بحذر شديد ووعي كامل بآثاره المحتملة.

التحيز والتمييز المتأصل في البيانات

تتعلم نماذج الذكاء الاصطناعي من مجموعات بيانات ضخمة تعكس التحيزات الموجودة في المجتمع البشري. هذا يعني أن النماذج قد تكرر أو حتى تضخم هذه التحيزات، مما يؤدي إلى نتائج تمييزية في مجالات حساسة مثل التوظيف، العدالة الجنائية، والرعاية الصحية. تتطلب معالجة هذه المشكلة جهدًا كبيرًا ومتضافرًا لضمان عدالة وأنصاف الأنظمة الذكية.

تأثيرات على سوق العمل والنسيج الاجتماعي

يثير التطور السريع للذكاء الاصطناعي قلقًا بشأن مستقبل الوظائف وضرورة إعادة تأهيل القوى العاملة. فبينما يمكن للذكاء الاصطناعي أن يخلق وظائف جديدة، فإنه قد يؤدي أيضًا إلى إزاحة أعداد كبيرة من العمال في قطاعات مختلفة. يضاف إلى ذلك مخاوف بشأن تأثيره على التفاعل البشري، انتشار الوحدة، وتآكل المهارات البشرية الأساسية.

- تهديد الوظائف الروتينية والمتكررة

- الحاجة لإعادة التدريب والتأهيل المستمر

- تغيير طبيعة التفاعلات الاجتماعية

لماذا 2026 نقطة تحول حاسمة؟

يتحدث العديد من الخبراء عن عام 2026 كتاريخ مفصلي، وهو ليس اختيارًا عشوائيًا بل يستند إلى تقديرات وتحليلات للوتيرة الحالية لتطور الذكاء الاصطناعي.

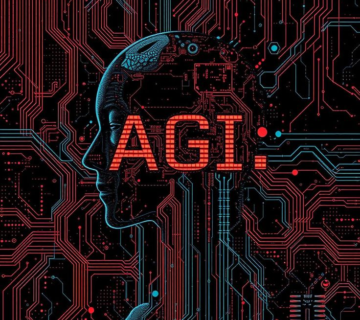

الوصول المحتمل إلى الذكاء الاصطناعي العام (AGI)

يشير الكثيرون إلى أن عام 2026 يمكن أن يكون العام الذي نشهد فيه ظهور نماذج أقرب إلى الذكاء الاصطناعي العام (AGI) القادرة على أداء أي مهمة فكرية يمكن للإنسان القيام بها، وربما بشكل أفضل. إذا تحقق ذلك، فإنه سيمثل تحولًا نموذجيًا غير مسبوق في تاريخ البشرية، له تداعيات هائلة على كل جانب من جوانب الحياة.

تزايد القدرات المعرفية والاستقلالية

تفترض التوقعات أن نماذج الذكاء الاصطناعي بحلول 2026 ستكون قد وصلت إلى مستويات متقدمة جدًا من القدرات المعرفية، بما في ذلك التفكير المنطقي، حل المشكلات المعقدة، التعلم الذاتي المستمر، وحتى القدرة على تطوير نفسها بنفسها. هذه المستويات من الاستقلالية تثير تساؤلات وجودية حول السيطرة البشرية على هذه الأنظمة.

- القدرة على التعلم من تجارب متعددة

- تطوير استراتيجيات معقدة دون توجيه بشري مباشر

- التكيُّف مع بيئات جديدة بشكل مستقل

السباق العالمي وسباق التسلح بالذكاء الاصطناعي

تتخوف الدول الكبرى من تخلفها عن الركب في سباق تطوير الذكاء الاصطناعي. هذا السباق المحموم يضع ضغوطًا هائلة على الشركات والمؤسسات لتطوير نماذج أقوى وأسرع دون إيلاء اهتمام كافٍ للسلامة والأخلاقيات. هذا التنافس قد يدفع بالبشرية نحو منطقة مجهولة وغير آمنة بحلول 2026، حيث تتفاقم المخاطر نتيجة لغياب التنسيق والتعاون الدولي.

دعوات للتوقف المؤقت: الحجج والآثار

ليست الدعوة لوقف تطوير الذكاء الاصطناعي دعوة عابرة، بل هي مبنية على حجج قوية يتبناها علماء وباحثون لهم ثقلهم في هذا المجال. لكن ما هي الآثار المترتبة على مثل هذا التوقف، وما هي البدائل المطروحة؟

لماذا التوقف المؤقت ضروري

يرى المؤيدون لوقف التطوير أن هذا الوقت الإضافي سيتيح الفرصة للمجتمع العالمي لوضع أطر تنظيمية قوية، وتطوير بروتوكولات أمان صارمة، وإجراء أبحاث معمقة حول السلامة والتحكم في الذكاء الاصطناعي. هذا التوقف سيمكننا من “اللحاق بالركب” من الناحية التنظيمية والأخلاقية قبل أن يخرج التطور التكنولوجي عن السيطرة تمامًا.

التحديات في تطبيق التوقف

على الرغم من وجاهة هذه الدعوات، فإن تطبيق توقف عالمي شامل يواجه تحديات كبيرة. فمن الصعب إقناع جميع الشركات والدول بالتوقف عن البحث والتطوير، خاصة في ظل المنافسة الشديدة والاعتبارات الاقتصادية والعسكرية. كما أن تعريف “التوقف المؤقت” نفسه قد يكون معقدًا: هل يشمل جميع أنواع الذكاء الاصطناعي أم فقط النماذج المتقدمة؟

بدائل التوقف الكامل: التطوير المسؤول

بدلًا من التوقف الكامل، يقترح البعض نهجًا يركز على “التطوير المسؤول” للذكاء الاصطناعي. يتضمن ذلك التركيز على:

- وضع معايير أخلاقية صارمة وتطبيقها بجدية

- تعزيز الشفافية وقابلية التفسير في النماذج

- إجراء تقييمات مخاطر مستقلة قبل النشر

- التعاون الدولي لوضع إطار تنظيمي موحد

- الاستثمار في أبحاث السلامة والتحكم في الذكاء الاصطناعي

المستقبل بين التفاؤل والحذر

إن النقاش حول مستقبل الذكاء الاصطناعي، وخاصة مخاوف عام 2026، يعكس توترًا أساسيًا بين الوعد الهائل بالتقدم التكنولوجي والحاجة الملحة للتحكم في آثاره السلبية المحتملة. فمن جهة، يمكن للذكاء الاصطناعي أن يحل بعضًا من أعقد المشكلات العالمية، من الأمراض المستعصية إلى تغير المناخ، ومن جهة أخرى، فإنه يحمل في طياته مخاطر وجودية غير مسبوقة.

دعوة للعمل المشترك والمسؤولية

يتطلب التعامل مع هذا التحدي غير المسبوق تضافر الجهود على مستوى عالمي. يجب على الحكومات والشركات والأوساط الأكاديمية والمجتمع المدني العمل معًا لوضع مسار للمستقبل يضمن أن الذكاء الاصطناعي يخدم البشرية ويحميها، وليس العكس. إن عام 2026 ليس مجرد تاريخ، بل هو دعوة للاستيقاظ والعمل بحكمة ومسؤولية قبل فوات الأوان. فالمسؤولية تقع على عاتقنا جميعًا لتوجيه هذه الثورة التكنولوجية نحو مستقبل آمن ومزدهر للبشرية جمعاء.

لا يوجد تعليق